今回は、LANDR、iZotope、Sonarworksが解説する「サンプルレートとは?ビット深度とは?」をまとめました。

DTMなどのオーディオに関わるときによく目にする「サンプルレート」と「ビット深度」について、図を使いながら解説します。

サンプルレート(Sample Rate)とは?

オーディオにおけるサンプルレート(Sample Rate)とは、1秒あたりに撮られるオーディオのスナップショットの数のことです。

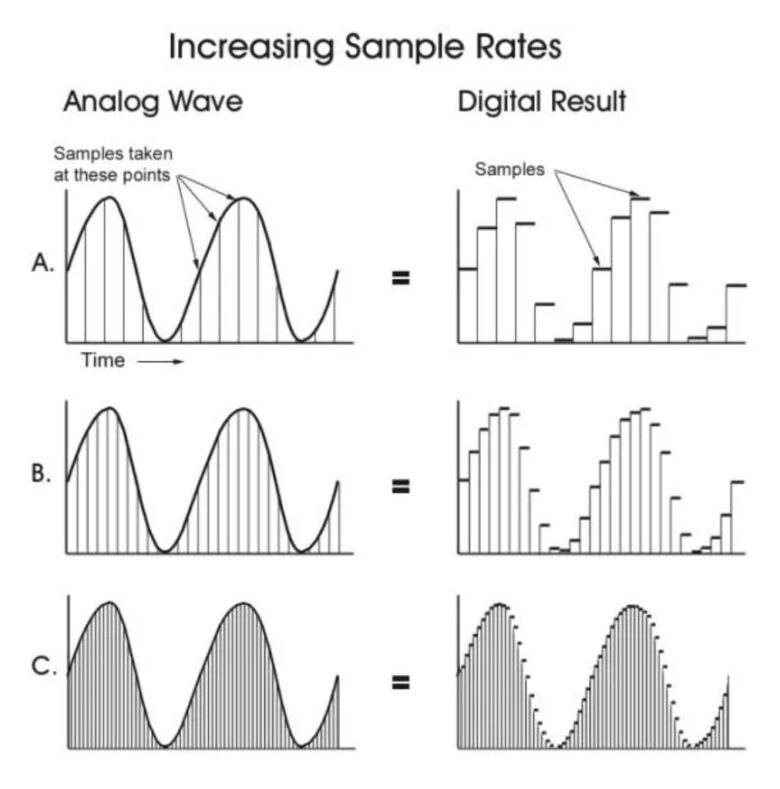

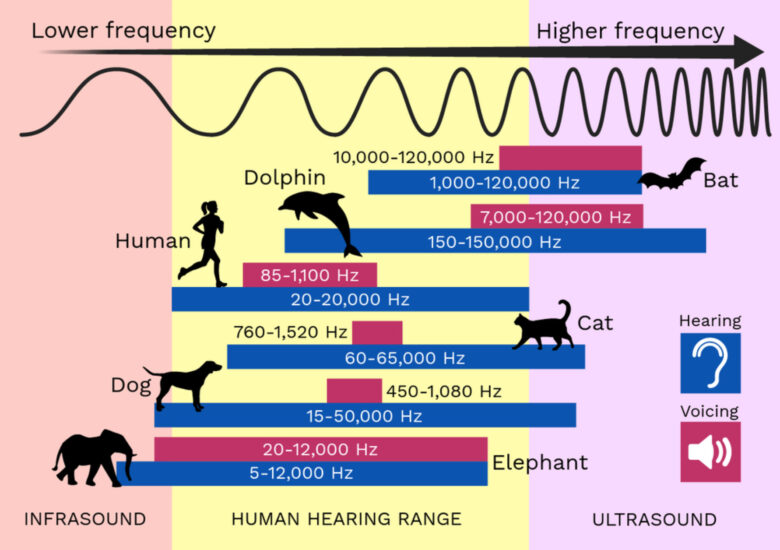

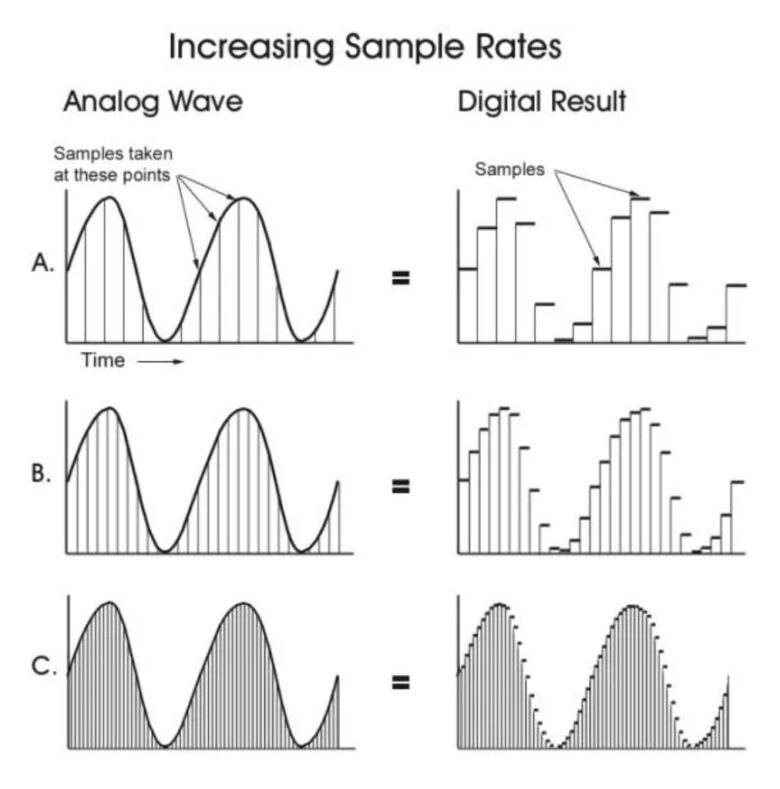

上記画像では一番下の「C」が最も細かくスナップショットが撮られていて、スナップショットを撮ったときの点をつなげると、元々の音の形に近いなめらかな曲線になっています。

言い換えると、オーディオインターフェースなどのADコンバーターによってアナログ信号がデジタル信号に変換されるとき、オーディオファイルがどれぐらい細かい周期でデータ化されるかを示す数値です。

ADコンバーターは「アナログ信号をデジタル信号に変換するパーツ」

アナログ信号は「人間に聞こえる・理解できるデータ」

デジタル信号は「コンピューターが編集・理解できるデータ」

例えばパラパラ漫画を作るとき、1秒間のアニメーションに使われる絵の枚数が多いと非常になめらかなアニメーションになりますが、これが「サンプルレートが高い状態」です。

一方で、1秒間のアニメーションに使われる枚数が多いとガタガタのアニメーションになりますが、これは「サンプルレートが低い状態」です。

音の波形は基本的になめらかな形をしているので、できるだけ細かくスナップショットを撮った方が元の状態を再現しやすくなります。

アナログ信号がデジタル信号に変換されるしくみ

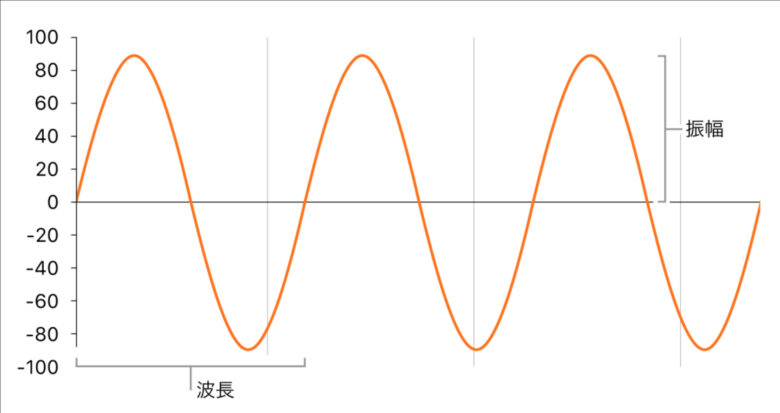

マイクから入ってきた楽器の音などのアナログ信号は、波のような形をしています。

この波の形は、電圧の変化を表しています。

DTMなどでは、このアナログ信号(楽器の音など)をパソコンに保存・編集できるようにしたいでしょう。

そのため、アナログ信号をデジタル信号として保存する必要があります。

このとき、アナログ信号の波形をできるだけ正確にデジタル信号として保存するために、ADコンバーターは音の波形を大量のスナップショットに変換します。

※パラパラ漫画をイメージするとわかりやすいです

サンプリングレートとは、この1秒あたりのスナップショットの枚数を表します。

※単位はヘルツ(Hz)

つまり、1秒あたりのスナップショットの枚数が多ければ多いほど、波形の動きを細かく保存できることになるので、音のクオリティが上がります。

DTM・DAWではどれぐらいのサンプルレートで設定するべきか?

一般的には、サンプルレートとビット深度(後述)が高ければ高いほど、よりよいクオリティになります。

しかし、例えば96kHzなどの高いサンプルレートでオーディオデータを作成すると、ファイルのサイズがとても大きくなってしまいます。

そしてファイルのサイズがとても大きい割には、そこまで音のクオリティの変化を感じにくいこともあります。

そのため、多くのチュートリアル・解説サイトや動画では、レコーディングでは44.1kHzのサンプルレートが一般的だと言われています。

しかし、音楽制作をしている人には以下で設定することをおすすめしています。

LANDR社のおすすめ

ファイルサイズと音質のバランスを考えると、48kHzをおすすめしています。

iZotope社のおすすめ

48kHz、96kHz、192kHzなど、できるだけ高い設定をおすすめしています。

SonarWorks社のおすすめ

基本的には44.1 kHzか48 kHzをおすすめしています。

(ヒット曲チャートのTOP40の楽曲はほとんどこの設定で制作されています)

非常に音質にこだわりたい場合は、96kHzがおすすめです。

特別な目的や理由があり、メリット・デメリットをしっかり理解していない限り、176kHz以上はおすすめしません。

もしレコーディングの音質を上げたいと思ったら、ぜひサンプルレートを上げてみてください。

それで実際に音質がよくなったと実感でき、パソコンの容量や処理速度にも問題がなければ、そのサンプルレートで制作するとよいでしょう。

フォーマットによるサンプルレートの基準は異なる

フォーマットによって、フォーマットが指定されていることがあります。

これらのフォーマット用に音楽制作をしている場合は、このサンプルレートで楽曲をバウンスする必要がありますので、ご注意ください。

CD用:44.1kHz

映像・映画:48kHz

ハイレゾ:192kHz

※ストリーミングサービスは、サービスによって44.1kHzしか受け付けていないことがあります

サンプルレートはなぜ最低値が40kHzではなく44.1kHzなのか?

DAWの設定を見てみると、基本的には44.1kHzが最も低いサンプルレートになっています。

これは、人間の可聴領域がおよそ20Hzから20kHzであり、「エイリアス」も考慮すると、この範囲を最低限カバーするためには44.1kHzのサンプルレートが必要だからです。

人間の耳は、一番低い音で20Hz、一番高い音で20kHzの音を認識することができます(20-20の法則)。

そしてコンピューターで音を再現するときは、その音の周波数の倍のサンプルレートを必要とします。

※その音を標本化するのに必要なサンプルレートの1/2の数字をナイキスト周波数と言います

例えば20Hzの音をコンピューターで再現するときは、40Hzのサンプルレートが必要になります。

コンピューターに音を保存したりDAWなどで音を作ったりするときは、人間の可聴領域である20Hz~20kHzを最低限カバーできれば問題ありません。

つまり、サンプルレートは最低でも40kHzあれば問題ありません。

エイリアス(Aliasing)とは?

エイリアス(Aliasing)とは、アナログ信号をデジタル信号に変換するときに発生するエラーのことです。

前述の「サンプルレート」の解説でお伝えしたとおり、マイクで音をレコーディングするときは、アナログ信号(マイクに入ってきた楽器の音など)を、コンピューターに取り込むためにデジタル信号に変換します。

このとき、サンプルレートが高ければキレイでなめらかな波形になりますが、サンプルレートが低いとガタガタの階段状のデータになります。

もう少し具体的に言うと、必要な分だけサンプルレートがないと(サンプルレートがナイキスト周波数の半分に満たない)、標本化後のデータは以下の画像のAやBのようになってしまいます。

上の画像のうち、一番下の「C」が最もサンプルレートが高いため、波形がとても細かく標本化され、アナログ信号とデジタル信号で全体の形に大きな差がありません。

しかし、一番上の「A」は最もサンプルレートが低いので、デジタル信号にすると階段状の形になり、元々のアナログ信号とはかなり異なる形になります。

※本来の音の波形を四捨五入するようにおおよそで標本化することを「クオンタイゼーション」と言います

このようにアナログ信号からデジタル信号に変換するとき、サンプルレートがナイキスト周波数の半分に満たない場合、データ(サンプル)に少し変化=エラーが起こり、本来は必要のない音も発生してしまうことがあります。

これが「エイリアス」です。

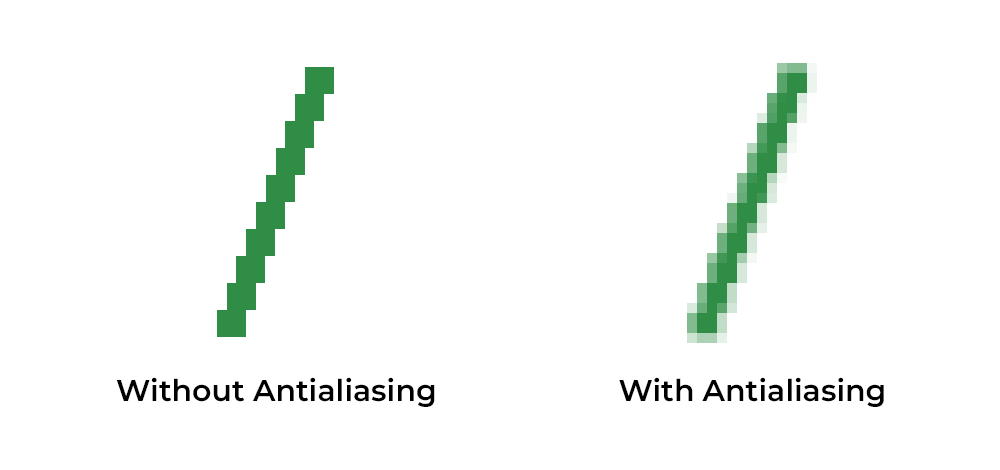

画像の場合は、輪郭が少しぼやけるようになってしまいます。

オーディオの場合のエイリアスは、耳に聞こえるレベルの音量であるだけでなく、音楽的ではない違和感のある倍音のように聞こえてしまうこともあります。

そのため、ローパスフィルター(アンチエイリアスフィルター)を使ってナイキスト周波数よりも上のエイリアス(不要な音)を取り除きます。

ローパスフィルターはコーヒーフィルターの役割

音の標本化におけるローパスフィルターは、コーヒーフィルターのような役割をしています。

コーヒーを作るには、お湯とコーヒー豆を使います。

コーヒーフィルターの中に挽いたコーヒー豆の粉を入れ、お湯を入れるとコーヒーフィルターを通してコーヒーが出来上がります。

いらない成分:エイリアスノイズ、コーヒー豆の粉

欲しい成分:サンプリングしたい本来の音、コーヒー

いらない成分を取り除く:コーヒーフィルター、ローパスフィルター

コーヒーフィルターを使わないと、確かにコーヒーは出来上がりますが、コーヒー豆の粉も一緒に飲んでしまうことになります。

必要な要素(本来の音、コーヒー)だけを残すために、フィルター(コーヒーフィルター、ローパスフィルター)を使います。

サンプルレートに40kHzではなく44.1kHzがよく使われる理由

DAWなどにおけるサンプルレートは最低値は、通常「44.1kHz」になっています。

人間の可聴領域は20Hzから20kHzなので、サンプルレートは最低限40kHzあれば問題ありません。

それではなぜ44.1kHzになっているかと言うと、これはCD時代の名残によるものです。

CD時代は、レコーディングスタジオからCDにデータを移動させるときに最も手軽で最適な手段がPCMアダプターを介す方法でした。

PCMアダプターは、デジタルオーディオをエンコードしてビデオフォーマットにし、ビデオカセットレコーダーで録音できるようにするためのデバイスです。

また、ビデオをデコードしてデジタルオーディオにすることもできたため、CD時代の初期はCDのマスタリングにも使われました。

このPCMアダプターの処理能力などを考えた結果、(会社によって数値が多少異なることはあったものの)44.1kHzがサンプルレートの基準となり、それが今でも使われています。

※SonyやPhilipsなどがCD用の基準として使っていたのは44.1kHzでした

より大きい数値のサンプルレートが必要な理由

98kHzや176kHzなど、より大きい数値のサンプルレートが必要な理由は2つあります。

44.1kHz以上のサンプルレートが必要な理由1.骨伝導を考えると人間は20kHz以上の音も聞こえるから

44.1kHzである理由の2つ目は「骨伝導を考えると人間は20kHz以上の音も聞こえるから」です。

音が耳ではなく骨を伝わって聞こえることを「骨伝導」と言いますが、この骨伝導を考慮すると、人間は50kHz程度の非常に高い音も知覚していると言われています。

とは言え、空気伝導で聞こえる最高音は20kHz程度ですので、最低でも20kHzの音がカバーできるのであれば(サンプルレートが44.1kHzあれば)人間にとっては十分だと言えます。

44.1kHz以上のサンプルレートが必要な理由2.サンプルレートを変更すると音が変わる製品があるため

アナログ信号をデジタル信号に変換するにはADコンバーターを使います。

このADコンバーターの質や、ADコンバーターと繋がれている部品の質によって、音質が変化することがあります。

例えばエイリアスに対してどのように対応するかによって、機材やプラグインから出る音が変化することがあります。

エイリアスをディストーションとして活用するプラグイン

これまでの説明を聞くと「エイリアス=悪いもの・避けるべきもの」というイメージがあるかもしれませんが、実はエイリアスを活用することもあります。

例えば世界中のプロに愛用されているD16 Group社「Decimort2」では、昔のサンプラーの質感を再現するために、わざとエイリアスを残すことができます。

もちろんアンチ・エイリアス機能もついているので、意図的にエイリアスを付け足したいときのみエイリアスを残すことができます。

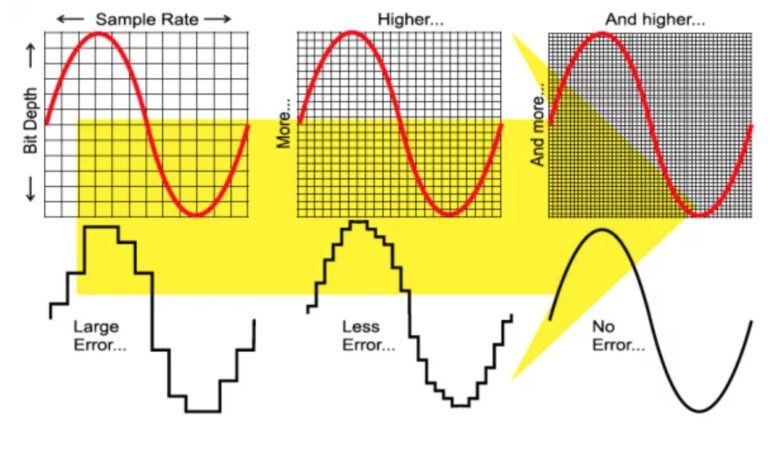

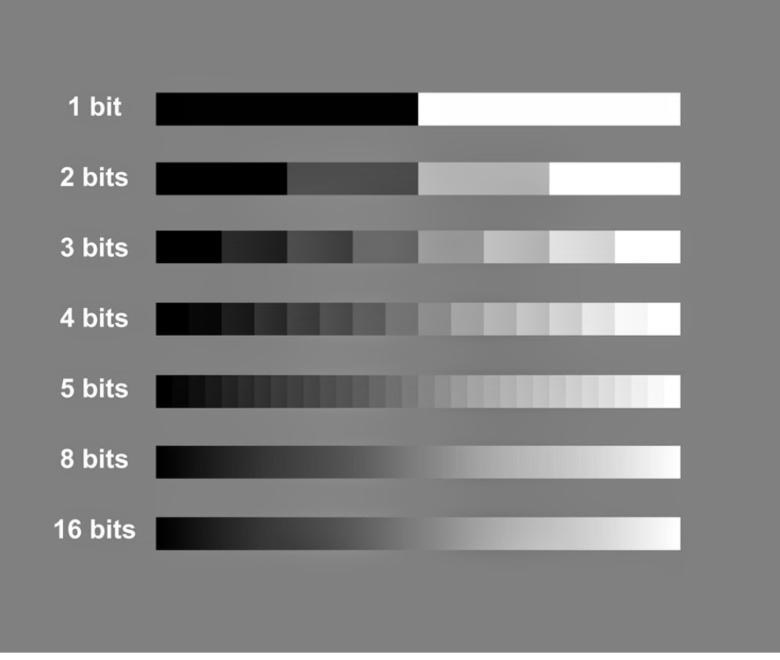

ビット深度(bit depth)とは?

ビット深度とは、「スナップショットの精度」を表す数値です。

先ほど、サンプルレートは「1秒あたりに撮影するスナップショットの枚数」だと説明しました。

このスナップショット1枚1枚の精度を表したのが、ビット深度です。

そのため、サンプルレートとビット深度はとても密接に関わっています。

例えば、オーディオインターフェースとマイクを使ってレコーディングをしているとします。

このとき、マイクから入ってきた音=アナログ信号は、ADコンバーターによってデジタル信号に変換されます。

この変換のとき、サンプルレートを48kHzに設定していれば、1秒あたり48,000回の変換作業を行います。

このとき、ビット深度はアナログ信号の大きさをマークする細かさを決めます。

より細かい目盛りを使って信号の大きさを測った方が、より精度の高いスナップショットが撮れる、ということになります。

ビット深度を定規や絵で考えてみよう

例えば定規で長さを測るとき、1cm単位でしか測れない定規を使うよりも、1mm単位で測れる定規の方が、より細かく正確に長さを測ることができます。

色で言えば、「黒と白」の2色でしか使えないときよりも、「黒・ダークグレー・ライトグレー・白」の4色を使える時の方が、より多彩な表現ができます。

DAWの設定を32bitに設定するときの注意点

多くのDAWでは、ビット深度を32bitに設定できます。

しかし、多くのオーディオインターフェースは24bitにしか対応していません。

そのため、DAWのプロジェクトのビット深度を32bitに設定するときは、MIDIで打ち込むような音源のみの音質に関わる設定となります。

レコーディングではなく打ち込みで楽曲を制作する場合で、32bitにした方が音質がいいと感じる場合は、ぜひDAWのビット深度を32bitに設定してみてください。

途中でサンプルレートやビット深度を変えてもいいのか?

多くのDAWでは、サンプルレートとビット深度をいつでも変更できるようになっています。

中には、あなたにとって最適な設定を自動的に設定してくれる製品もあります。

このDAWでサンプルレートとビット深度を設定するときに気をつけて欲しいのが、事前に適切な設定を選んでおくということです。

後から変更してしまうと、場合によっては音質が悪くなってしまうなどのデメリットが発生することがあります。

ファイルサイズが大きくなってしまったり、パソコンのCPUの負荷が大きくなってしまうという懸念点はありますが、可能であればできる限り高いサンプルレート・ビット深度で製作を進めることをおすすめします。

ダウンサンプリング(Down Sampling)とは?

ダウンサンプリング(Down Sampling)とは、高いサンプルレートから低いサンプルレートに変更することです。

例えば、ビット深度を24bit、サンプルレートを48kHzに設定して制作をしていた楽曲を、CD用に16bit・44.1kHzでバウンスすることがあります。

これはCDのフォーマットがそのように決まっているので仕方がないのですが、より低いサンプルレートに変更するとその分だけ情報量が減るため、場合によっては音質が低下することがあります。

ダウンサンプリングは、基本的に正しく行えば何の問題もありません。

しかし、できる限り高音質を保つため、ダウンサンプリングは楽曲製作の一番最後の段階(DAWで楽曲をバウンスするとき)のみに留めておくことをおすすめします。

アップサンプリング(Up Sampling)とは?

アップサンプリング(Up Sampling)とは、低いサンプルレートから高いサンプルレートに変更することです。

残念ながら、すでに低いサンプルレートで制作してしまっている場合、高いサンプルレートに変更したからと言って情報量が増え、音質がアップするということはありません。

画像処理におけるアップサンプリングであればよりよい結果が生まれることがありますが、基本的にオーディオの世界では起こらないので、本当に必要になったときだけ行うのがよいでしょう。

オーバーサンプリング(Over Sampling)とは?

オーバーサンプリング(Over Sampling)とは、現在設定しているサンプルレートよりも高い数値で処理することで、エイリアスを減らす技術です。

現代発売されている多くのプラグインに備わっている機能です。

ディストーション系プラグインやコンプレッサープラグインなどに備わっていることが多く、オーバーサンプリングをONにすると豊かでキレイな倍音成分を足しながら、エイリアスの発生を避けることができます。

ただし、オーバーサンプリングを行うとCPU負荷が大きくなりますので、こちらは注意が必要です。

サンプルレートとビット深度とは?まとめ

以上が「サンプルレートとビット深度とは?」の解説でした。

サンプルレート(Sample Rate)

1秒あたりに撮られるオーディオのスナップショットの数のこと

1秒間のアニメーションに使われる枚数が多いとガタガタのアニメーションになる=サンプルレートが低い状態

ビット深度(Bit Depth)

サンプルレートで撮ったスナップショットの精度のこと

色「黒と白」の2色でしか使えないときよりも、「黒・ダークグレー・ライトグレー・白」の4色を使える時の方が多彩な表現ができる=ビット深度が高い状態

ダウンサンプリング(Down Sampling)

高いサンプルレートから低いサンプルレートに変更すること

アップサンプリング(Up Sampling)

低いサンプルレートから高いサンプルレートに変更すること

オーバーサンプリング(Over Sampling)

現在設定しているサンプルレートよりも高い数値で処理することで、エイリアスを減らす技術

当サイトでは他にもオーディオ用語について解説していますので、ぜひこちらもご覧ください↓

https://www.izotope.com/en/learn/digital-audio-basics-sample-rate-and-bit-depth.html

https://blog.landr.com/sample-rate-bit-depth/

https://www.sonarworks.com/blog/learn/sample-rate

https://www.psaudio.com/blogs/pauls-posts/sample-rates

https://manual.audacityteam.org/man/sample_rates.html

https://en.wikipedia.org/wiki/44,100_Hz

https://www.musicguymixing.com/what-is-aliasing/

http://sites.music.columbia.edu/cmc/MusicAndComputers/chapter2/02_03.php